-功能(⭐= 近期新增功能) | 描述

---- | ---

-⭐[接入新模型](https://github.com/binary-husky/gpt_academic/wiki/%E5%A6%82%E4%BD%95%E5%88%87%E6%8D%A2%E6%A8%A1%E5%9E%8B) | 百度[千帆](https://cloud.baidu.com/doc/WENXINWORKSHOP/s/Nlks5zkzu)与文心一言, 通义千问[Qwen](https://modelscope.cn/models/qwen/Qwen-7B-Chat/summary),上海AI-Lab[书生](https://github.com/InternLM/InternLM),讯飞[星火](https://xinghuo.xfyun.cn/),[LLaMa2](https://huggingface.co/meta-llama/Llama-2-7b-chat-hf),[智谱API](https://open.bigmodel.cn/),DALLE3, [DeepseekCoder](https://coder.deepseek.com/)

-润色、翻译、代码解释 | 一键润色、翻译、查找论文语法错误、解释代码

-[自定义快捷键](https://www.bilibili.com/video/BV14s4y1E7jN) | 支持自定义快捷键

-模块化设计 | 支持自定义强大的[插件](https://github.com/binary-husky/gpt_academic/tree/master/crazy_functions),插件支持[热更新](https://github.com/binary-husky/gpt_academic/wiki/%E5%87%BD%E6%95%B0%E6%8F%92%E4%BB%B6%E6%8C%87%E5%8D%97)

-[程序剖析](https://www.bilibili.com/video/BV1cj411A7VW) | [插件] 一键剖析Python/C/C++/Java/Lua/...项目树 或 [自我剖析](https://www.bilibili.com/video/BV1cj411A7VW)

-读论文、[翻译](https://www.bilibili.com/video/BV1KT411x7Wn)论文 | [插件] 一键解读latex/pdf论文全文并生成摘要

-Latex全文[翻译](https://www.bilibili.com/video/BV1nk4y1Y7Js/)、[润色](https://www.bilibili.com/video/BV1FT411H7c5/) | [插件] 一键翻译或润色latex论文

-批量注释生成 | [插件] 一键批量生成函数注释

-Markdown[中英互译](https://www.bilibili.com/video/BV1yo4y157jV/) | [插件] 看到上面5种语言的[README](https://github.com/binary-husky/gpt_academic/blob/master/docs/README_EN.md)了吗?就是出自他的手笔

-chat分析报告生成 | [插件] 运行后自动生成总结汇报

-[PDF论文全文翻译功能](https://www.bilibili.com/video/BV1KT411x7Wn) | [插件] PDF论文提取题目&摘要+翻译全文(多线程)

-[Arxiv小助手](https://www.bilibili.com/video/BV1LM4y1279X) | [插件] 输入arxiv文章url即可一键翻译摘要+下载PDF

-Latex论文一键校对 | [插件] 仿Grammarly对Latex文章进行语法、拼写纠错+输出对照PDF

-[谷歌学术统合小助手](https://www.bilibili.com/video/BV19L411U7ia) | [插件] 给定任意谷歌学术搜索页面URL,让gpt帮你[写relatedworks](https://www.bilibili.com/video/BV1GP411U7Az/)

-互联网信息聚合+GPT | [插件] 一键[让GPT从互联网获取信息](https://www.bilibili.com/video/BV1om4y127ck)回答问题,让信息永不过时

-⭐Arxiv论文精细翻译 ([Docker](https://github.com/binary-husky/gpt_academic/pkgs/container/gpt_academic_with_latex)) | [插件] 一键[以超高质量翻译arxiv论文](https://www.bilibili.com/video/BV1dz4y1v77A/),目前最好的论文翻译工具

-⭐[实时语音对话输入](https://github.com/binary-husky/gpt_academic/blob/master/docs/use_audio.md) | [插件] 异步[监听音频](https://www.bilibili.com/video/BV1AV4y187Uy/),自动断句,自动寻找回答时机

-公式/图片/表格显示 | 可以同时显示公式的[tex形式和渲染形式](https://user-images.githubusercontent.com/96192199/230598842-1d7fcddd-815d-40ee-af60-baf488a199df.png),支持公式、代码高亮

-⭐AutoGen多智能体插件 | [插件] 借助微软AutoGen,探索多Agent的智能涌现可能!

-启动暗色[主题](https://github.com/binary-husky/gpt_academic/issues/173) | 在浏览器url后面添加```/?__theme=dark```可以切换dark主题

-[多LLM模型](https://www.bilibili.com/video/BV1wT411p7yf)支持 | 同时被GPT3.5、GPT4、[清华ChatGLM2](https://github.com/THUDM/ChatGLM2-6B)、[复旦MOSS](https://github.com/OpenLMLab/MOSS)伺候的感觉一定会很不错吧?

-⭐ChatGLM2微调模型 | 支持加载ChatGLM2微调模型,提供ChatGLM2微调辅助插件

-更多LLM模型接入,支持[huggingface部署](https://huggingface.co/spaces/qingxu98/gpt-academic) | 加入Newbing接口(新必应),引入清华[Jittorllms](https://github.com/Jittor/JittorLLMs)支持[LLaMA](https://github.com/facebookresearch/llama)和[盘古α](https://openi.org.cn/pangu/)

-⭐[void-terminal](https://github.com/binary-husky/void-terminal) pip包 | 脱离GUI,在Python中直接调用本项目的所有函数插件(开发中)

-⭐虚空终端插件 | [插件] 能够使用自然语言直接调度本项目其他插件

-更多新功能展示 (图像生成等) …… | 见本文档结尾处 ……

+| 功能(⭐= 近期新增功能) | 描述 |

+| ------------------------------------------------------------------------------------------------------------------------ | --------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------- |

+| ⭐[接入新模型](https://github.com/binary-husky/gpt_academic/wiki/%E5%A6%82%E4%BD%95%E5%88%87%E6%8D%A2%E6%A8%A1%E5%9E%8B) | 百度[千帆](https://cloud.baidu.com/doc/WENXINWORKSHOP/s/Nlks5zkzu)与文心一言, 通义千问[Qwen-7B](https://modelscope.cn/models/qwen/Qwen-7B-Chat/summary),通义千问[Qwen-1_8B](https://modelscope.cn/models/qwen/Qwen-1_8B-Chat/summary),上海 AI-Lab[书生](https://github.com/InternLM/InternLM),讯飞[星火](https://xinghuo.xfyun.cn/),[LLaMa2](https://huggingface.co/meta-llama/Llama-2-7b-chat-hf),[智谱 API](https://open.bigmodel.cn/),DALLE3, [DeepseekCoder](https://coder.deepseek.com/) |

+| 润色、翻译、代码解释 | 一键润色、翻译、查找论文语法错误、解释代码 |

+| [自定义快捷键](https://www.bilibili.com/video/BV14s4y1E7jN) | 支持自定义快捷键 |

+| 模块化设计 | 支持自定义强大的[插件](https://github.com/binary-husky/gpt_academic/tree/master/crazy_functions),插件支持[热更新](https://github.com/binary-husky/gpt_academic/wiki/%E5%87%BD%E6%95%B0%E6%8F%92%E4%BB%B6%E6%8C%87%E5%8D%97) |

+| [程序剖析](https://www.bilibili.com/video/BV1cj411A7VW) | [插件] 一键剖析 Python/C/C++/Java/Lua/...项目树 或 [自我剖析](https://www.bilibili.com/video/BV1cj411A7VW) |

+| 读论文、[翻译](https://www.bilibili.com/video/BV1KT411x7Wn)论文 | [插件] 一键解读 latex/pdf 论文全文并生成摘要 |

+| Latex 全文[翻译](https://www.bilibili.com/video/BV1nk4y1Y7Js/)、[润色](https://www.bilibili.com/video/BV1FT411H7c5/) | [插件] 一键翻译或润色 latex 论文 |

+| 批量注释生成 | [插件] 一键批量生成函数注释 |

+| Markdown[中英互译](https://www.bilibili.com/video/BV1yo4y157jV/) | [插件] 看到上面 5 种语言的[README](https://github.com/binary-husky/gpt_academic/blob/master/docs/README_EN.md)了吗?就是出自他的手笔 |

+| chat 分析报告生成 | [插件] 运行后自动生成总结汇报 |

+| [PDF 论文全文翻译功能](https://www.bilibili.com/video/BV1KT411x7Wn) | [插件] PDF 论文提取题目&摘要+翻译全文(多线程) |

+| [Arxiv 小助手](https://www.bilibili.com/video/BV1LM4y1279X) | [插件] 输入 arxiv 文章 url 即可一键翻译摘要+下载 PDF |

+| Latex 论文一键校对 | [插件] 仿 Grammarly 对 Latex 文章进行语法、拼写纠错+输出对照 PDF |

+| [谷歌学术统合小助手](https://www.bilibili.com/video/BV19L411U7ia) | [插件] 给定任意谷歌学术搜索页面 URL,让 gpt 帮你[写 relatedworks](https://www.bilibili.com/video/BV1GP411U7Az/) |

+| 互联网信息聚合+GPT | [插件] 一键[让 GPT 从互联网获取信息](https://www.bilibili.com/video/BV1om4y127ck)回答问题,让信息永不过时 |

+| ⭐Arxiv 论文精细翻译 ([Docker](https://github.com/binary-husky/gpt_academic/pkgs/container/gpt_academic_with_latex)) | [插件] 一键[以超高质量翻译 arxiv 论文](https://www.bilibili.com/video/BV1dz4y1v77A/),目前最好的论文翻译工具 |

+| ⭐[实时语音对话输入](https://github.com/binary-husky/gpt_academic/blob/master/docs/use_audio.md) | [插件] 异步[监听音频](https://www.bilibili.com/video/BV1AV4y187Uy/),自动断句,自动寻找回答时机 |

+| 公式/图片/表格显示 | 可以同时显示公式的[tex 形式和渲染形式](https://user-images.githubusercontent.com/96192199/230598842-1d7fcddd-815d-40ee-af60-baf488a199df.png),支持公式、代码高亮 |

+| ⭐AutoGen 多智能体插件 | [插件] 借助微软 AutoGen,探索多 Agent 的智能涌现可能! |

+| 启动暗色[主题](https://github.com/binary-husky/gpt_academic/issues/173) | 在浏览器 url 后面添加`/?__theme=dark`可以切换 dark 主题 |

+| [多 LLM 模型](https://www.bilibili.com/video/BV1wT411p7yf)支持 | 同时被 GPT3.5、GPT4、[清华 ChatGLM2](https://github.com/THUDM/ChatGLM2-6B)、[复旦 MOSS](https://github.com/OpenLMLab/MOSS)伺候的感觉一定会很不错吧? |

+| ⭐ChatGLM2 微调模型 | 支持加载 ChatGLM2 微调模型,提供 ChatGLM2 微调辅助插件 |

+| 更多 LLM 模型接入,支持[huggingface 部署](https://huggingface.co/spaces/qingxu98/gpt-academic) | 加入 Newbing 接口(新必应),引入清华[Jittorllms](https://github.com/Jittor/JittorLLMs)支持[LLaMA](https://github.com/facebookresearch/llama)和[盘古 α](https://openi.org.cn/pangu/) |

+| ⭐[void-terminal](https://github.com/binary-husky/void-terminal) pip 包 | 脱离 GUI,在 Python 中直接调用本项目的所有函数插件(开发中) |

+| ⭐ 虚空终端插件 | [插件] 能够使用自然语言直接调度本项目其他插件 |

+| 更多新功能展示 (图像生成等) …… | 见本文档结尾处 …… |

+

-

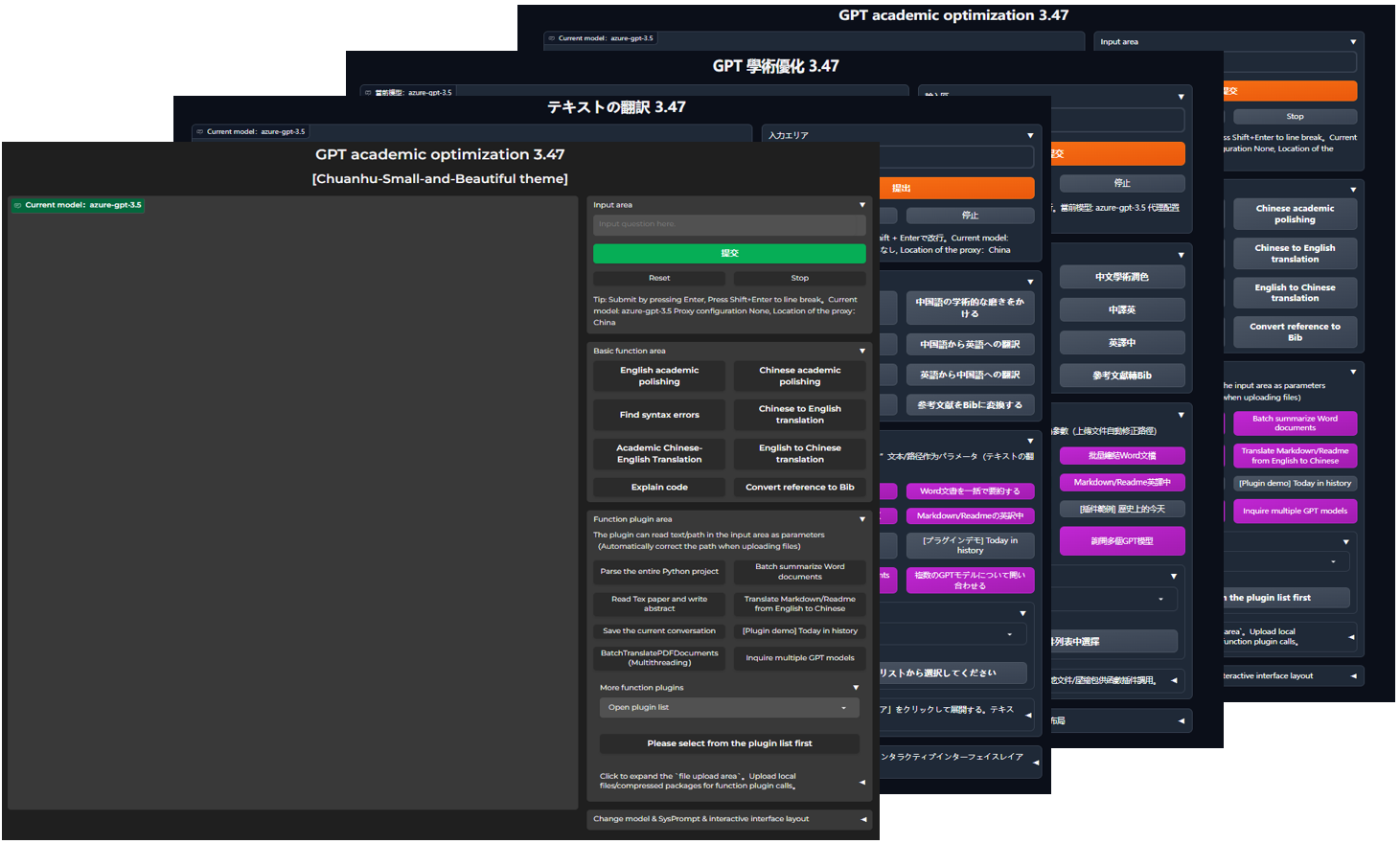

-- 新界面(修改`config.py`中的LAYOUT选项即可实现“左右布局”和“上下布局”的切换)

+- 新界面(修改`config.py`中的 LAYOUT 选项即可实现“左右布局”和“上下布局”的切换)

===>

@@ -270,7 +267,7 @@ Tip:不指定文件直接点击 `载入对话历史存档` 可以查看历史h

3. 虚空终端(从自然语言输入中,理解用户意图+自动调用其他插件)

-- 步骤一:输入 “ 请调用插件翻译PDF论文,地址为https://openreview.net/pdf?id=rJl0r3R9KX ”

+- 步骤一:输入 “ 请调用插件翻译 PDF 论文,地址为https://openreview.net/pdf?id=rJl0r3R9KX ”

- 步骤二:点击“虚空终端”

@@ -294,17 +291,17 @@ Tip:不指定文件直接点击 `载入对话历史存档` 可以查看历史h

-7. OpenAI图像生成

+7. OpenAI 图像生成

-8. OpenAI音频解析与总结

+8. OpenAI 音频解析与总结

-9. Latex全文校对纠错

+9. Latex 全文校对纠错

===>

@@ -315,47 +312,46 @@ Tip:不指定文件直接点击 `载入对话历史存档` 可以查看历史h

-

-

### II:版本:

-- version 3.70(todo): 优化AutoGen插件主题并设计一系列衍生插件

-- version 3.60: 引入AutoGen作为新一代插件的基石

-- version 3.57: 支持GLM3,星火v3,文心一言v4,修复本地模型的并发BUG

-- version 3.56: 支持动态追加基础功能按钮,新汇报PDF汇总页面

+- version 3.70(todo): 优化 AutoGen 插件主题并设计一系列衍生插件

+- version 3.60: 引入 AutoGen 作为新一代插件的基石

+- version 3.57: 支持 GLM3,星火 v3,文心一言 v4,修复本地模型的并发 BUG

+- version 3.56: 支持动态追加基础功能按钮,新汇报 PDF 汇总页面

- version 3.55: 重构前端界面,引入悬浮窗口与菜单栏

- version 3.54: 新增动态代码解释器(Code Interpreter)(待完善)

- version 3.53: 支持动态选择不同界面主题,提高稳定性&解决多用户冲突问题

-- version 3.50: 使用自然语言调用本项目的所有函数插件(虚空终端),支持插件分类,改进UI,设计新主题

+- version 3.50: 使用自然语言调用本项目的所有函数插件(虚空终端),支持插件分类,改进 UI,设计新主题

- version 3.49: 支持百度千帆平台和文心一言

-- version 3.48: 支持阿里达摩院通义千问,上海AI-Lab书生,讯飞星火

+- version 3.48: 支持阿里达摩院通义千问,上海 AI-Lab 书生,讯飞星火

- version 3.46: 支持完全脱手操作的实时语音对话

-- version 3.45: 支持自定义ChatGLM2微调模型

-- version 3.44: 正式支持Azure,优化界面易用性

-- version 3.4: +arxiv论文翻译、latex论文批改功能

+- version 3.45: 支持自定义 ChatGLM2 微调模型

+- version 3.44: 正式支持 Azure,优化界面易用性

+- version 3.4: +arxiv 论文翻译、latex 论文批改功能

- version 3.3: +互联网信息综合功能

-- version 3.2: 函数插件支持更多参数接口 (保存对话功能, 解读任意语言代码+同时询问任意的LLM组合)

-- version 3.1: 支持同时问询多个gpt模型!支持api2d,支持多个apikey负载均衡

-- version 3.0: 对chatglm和其他小型llm的支持

+- version 3.2: 函数插件支持更多参数接口 (保存对话功能, 解读任意语言代码+同时询问任意的 LLM 组合)

+- version 3.1: 支持同时问询多个 gpt 模型!支持 api2d,支持多个 apikey 负载均衡

+- version 3.0: 对 chatglm 和其他小型 llm 的支持

- version 2.6: 重构了插件结构,提高了交互性,加入更多插件

-- version 2.5: 自更新,解决总结大工程源代码时文本过长、token溢出的问题

-- version 2.4: 新增PDF全文翻译功能; 新增输入区切换位置的功能

+- version 2.5: 自更新,解决总结大工程源代码时文本过长、token 溢出的问题

+- version 2.4: 新增 PDF 全文翻译功能; 新增输入区切换位置的功能

- version 2.3: 增强多线程交互性

- version 2.2: 函数插件支持热重载

- version 2.1: 可折叠式布局

- version 2.0: 引入模块化函数插件

- version 1.0: 基础功能

-GPT Academic开发者QQ群:`610599535`

+GPT Academic 开发者 QQ 群:`610599535`

- 已知问题

- - 某些浏览器翻译插件干扰此软件前端的运行

- - 官方Gradio目前有很多兼容性问题,请**务必使用`requirement.txt`安装Gradio**

+ - 某些浏览器翻译插件干扰此软件前端的运行

+ - 官方 Gradio 目前有很多兼容性问题,请**务必使用`requirement.txt`安装 Gradio**

### III:主题

-可以通过修改`THEME`选项(config.py)变更主题

-1. `Chuanhu-Small-and-Beautiful` [网址](https://github.com/GaiZhenbiao/ChuanhuChatGPT/)

+可以通过修改`THEME`选项(config.py)变更主题

+

+1. `Chuanhu-Small-and-Beautiful` [网址](https://github.com/GaiZhenbiao/ChuanhuChatGPT/)

### IV:本项目的开发分支

@@ -363,7 +359,6 @@ GPT Academic开发者QQ群:`610599535`

2. `frontier` 分支: 开发分支,测试版

3. 如何接入其他大模型:[接入其他大模型](request_llms/README.md)

-

### V:参考与学习

```

diff --git a/config.py b/config.py

index 4284cb8..45365f5 100644

--- a/config.py

+++ b/config.py

@@ -91,10 +91,10 @@ AVAIL_LLM_MODELS = ["gpt-3.5-turbo-1106","gpt-4-1106-preview","gpt-4-vision-prev

"gpt-3.5-turbo-16k", "gpt-3.5-turbo", "azure-gpt-3.5",

"api2d-gpt-3.5-turbo", 'api2d-gpt-3.5-turbo-16k',

"gpt-4", "gpt-4-32k", "azure-gpt-4", "api2d-gpt-4",

- "chatglm3", "moss", "claude-2","qwen"]

-# P.S. 其他可用的模型还包括 ["zhipuai", "qianfan", "deepseekcoder", "llama2", "qwen", "gpt-3.5-turbo-0613", "gpt-3.5-turbo-16k-0613", "gpt-3.5-random"

+ "chatglm3", "moss", "claude-2","qwen-1_8B","qwen-7B"]

+# P.S. 其他可用的模型还包括 ["zhipuai", "qianfan", "deepseekcoder", "llama2", "gpt-3.5-turbo-0613", "gpt-3.5-turbo-16k-0613", "gpt-3.5-random"

# "spark", "sparkv2", "sparkv3", "chatglm_onnx", "claude-1-100k", "claude-2", "internlm", "jittorllms_pangualpha", "jittorllms_llama"]

-# 如果你需要使用Qwen的本地模型,比如qwen1.8b,那么还需要在request_llms\bridge_qwen.py设置一下模型的路径!

+# 如果你需要使用Qwen的本地模型,比如qwen1.8b,那么还需要在request_llms下找到对应的文件,设置一下模型的路径!

# 定义界面上“询问多个GPT模型”插件应该使用哪些模型,请从AVAIL_LLM_MODELS中选择,并在不同模型之间用`&`间隔,例如"gpt-3.5-turbo&chatglm3&azure-gpt-4"

MULTI_QUERY_LLM_MODELS = "gpt-3.5-turbo&chatglm3"

@@ -291,7 +291,8 @@ NUM_CUSTOM_BASIC_BTN = 4

├── "jittorllms_pangualpha"

├── "jittorllms_llama"

├── "deepseekcoder"

-├── "qwen"

+├── "qwen-1_8B"

+├── "qwen-7B"

├── RWKV的支持见Wiki

└── "llama2"

diff --git a/request_llms/bridge_all.py b/request_llms/bridge_all.py

index 8dece54..f20ca65 100644

--- a/request_llms/bridge_all.py

+++ b/request_llms/bridge_all.py

@@ -431,12 +431,12 @@ if "chatglm_onnx" in AVAIL_LLM_MODELS:

})

except:

print(trimmed_format_exc())

-if "qwen" in AVAIL_LLM_MODELS:

+if "qwen-1_8B" in AVAIL_LLM_MODELS: # qwen-1.8B

try:

- from .bridge_qwen import predict_no_ui_long_connection as qwen_noui

- from .bridge_qwen import predict as qwen_ui

+ from .bridge_qwen_1_8B import predict_no_ui_long_connection as qwen_noui

+ from .bridge_qwen_1_8B import predict as qwen_ui

model_info.update({

- "qwen": {

+ "qwen-1_8B": {

"fn_with_ui": qwen_ui,

"fn_without_ui": qwen_noui,

"endpoint": None,

@@ -447,6 +447,24 @@ if "qwen" in AVAIL_LLM_MODELS:

})

except:

print(trimmed_format_exc())

+

+if "qwen-7B" in AVAIL_LLM_MODELS: # qwen-7B

+ try:

+ from .bridge_qwen_7B import predict_no_ui_long_connection as qwen_noui

+ from .bridge_qwen_7B import predict as qwen_ui

+ model_info.update({

+ "qwen-7B": {

+ "fn_with_ui": qwen_ui,

+ "fn_without_ui": qwen_noui,

+ "endpoint": None,

+ "max_token": 4096,

+ "tokenizer": tokenizer_gpt35,

+ "token_cnt": get_token_num_gpt35,

+ }

+ })

+ except:

+ print(trimmed_format_exc())

+

if "chatgpt_website" in AVAIL_LLM_MODELS: # 接入一些逆向工程https://github.com/acheong08/ChatGPT-to-API/

try:

from .bridge_chatgpt_website import predict_no_ui_long_connection as chatgpt_website_noui

diff --git a/request_llms/bridge_qwen_1_8B.py b/request_llms/bridge_qwen_1_8B.py

new file mode 100644

index 0000000..0628830

--- /dev/null

+++ b/request_llms/bridge_qwen_1_8B.py

@@ -0,0 +1,67 @@

+model_name = "Qwen1_8B"

+cmd_to_install = "`pip install -r request_llms/requirements_qwen.txt`"

+

+

+from transformers import AutoModel, AutoTokenizer

+import time

+import threading

+import importlib

+from toolbox import update_ui, get_conf, ProxyNetworkActivate

+from multiprocessing import Process, Pipe

+from .local_llm_class import LocalLLMHandle, get_local_llm_predict_fns

+

+

+

+# ------------------------------------------------------------------------------------------------------------------------

+# 🔌💻 Local Model

+# ------------------------------------------------------------------------------------------------------------------------

+class GetQwenLMHandle(LocalLLMHandle):

+

+ def load_model_info(self):

+ # 🏃♂️🏃♂️🏃♂️ 子进程执行

+ self.model_name = model_name

+ self.cmd_to_install = cmd_to_install

+

+ def load_model_and_tokenizer(self):

+ # 🏃♂️🏃♂️🏃♂️ 子进程执行

+ import os, glob

+ import os

+ import platform

+ from modelscope import AutoModelForCausalLM, AutoTokenizer, GenerationConfig

+

+ with ProxyNetworkActivate('Download_LLM'):

+ model_id = 'Qwen/Qwen-1_8B-Chat'

+ self._tokenizer = AutoTokenizer.from_pretrained('Qwen/Qwen-1_8B-Chat', trust_remote_code=True, resume_download=True)

+ # use fp16

+ model = AutoModelForCausalLM.from_pretrained(model_id, device_map="auto", trust_remote_code=True, fp16=True).eval()

+ model.generation_config = GenerationConfig.from_pretrained(model_id, trust_remote_code=True) # 可指定不同的生成长度、top_p等相关超参

+ self._model = model

+

+ return self._model, self._tokenizer

+

+ def llm_stream_generator(self, **kwargs):

+ # 🏃♂️🏃♂️🏃♂️ 子进程执行

+ def adaptor(kwargs):

+ query = kwargs['query']

+ max_length = kwargs['max_length']

+ top_p = kwargs['top_p']

+ temperature = kwargs['temperature']

+ history = kwargs['history']

+ return query, max_length, top_p, temperature, history

+

+ query, max_length, top_p, temperature, history = adaptor(kwargs)

+

+ for response in self._model.chat_stream(self._tokenizer, query, history=history):

+ yield response

+

+ def try_to_import_special_deps(self, **kwargs):

+ # import something that will raise error if the user does not install requirement_*.txt

+ # 🏃♂️🏃♂️🏃♂️ 主进程执行

+ import importlib

+ importlib.import_module('modelscope')

+

+

+# ------------------------------------------------------------------------------------------------------------------------

+# 🔌💻 GPT-Academic Interface

+# ------------------------------------------------------------------------------------------------------------------------

+predict_no_ui_long_connection, predict = get_local_llm_predict_fns(GetQwenLMHandle, model_name)

\ No newline at end of file

diff --git a/request_llms/bridge_qwen.py b/request_llms/bridge_qwen_7B.py

similarity index 99%

rename from request_llms/bridge_qwen.py

rename to request_llms/bridge_qwen_7B.py

index d8408d8..dfe1fc4 100644

--- a/request_llms/bridge_qwen.py

+++ b/request_llms/bridge_qwen_7B.py

@@ -1,4 +1,4 @@

-model_name = "Qwen"

+model_name = "Qwen-7B"

cmd_to_install = "`pip install -r request_llms/requirements_qwen.txt`"

diff --git a/tests/test_llms.py b/tests/test_llms.py

index 8b68597..2426cc3 100644

--- a/tests/test_llms.py

+++ b/tests/test_llms.py

@@ -16,8 +16,9 @@ if __name__ == "__main__":

# from request_llms.bridge_jittorllms_llama import predict_no_ui_long_connection

# from request_llms.bridge_claude import predict_no_ui_long_connection

# from request_llms.bridge_internlm import predict_no_ui_long_connection

- from request_llms.bridge_deepseekcoder import predict_no_ui_long_connection

- # from request_llms.bridge_qwen import predict_no_ui_long_connection

+ # from request_llms.bridge_deepseekcoder import predict_no_ui_long_connection

+ # from request_llms.bridge_qwen_7B import predict_no_ui_long_connection

+ from request_llms.bridge_qwen_1_8B import predict_no_ui_long_connection

# from request_llms.bridge_spark import predict_no_ui_long_connection

# from request_llms.bridge_zhipu import predict_no_ui_long_connection

# from request_llms.bridge_chatglm3 import predict_no_ui_long_connection

-- 如果输出包含公式,会以tex形式和渲染形式同时显示,方便复制和阅读

+- 如果输出包含公式,会以 tex 形式和渲染形式同时显示,方便复制和阅读

-- 如果输出包含公式,会以tex形式和渲染形式同时显示,方便复制和阅读

+- 如果输出包含公式,会以 tex 形式和渲染形式同时显示,方便复制和阅读